ChatGPTやGemini、Copilotといったツールが日常に浸透する中で、どう向き合えばいいのか。

1. 「生成AI」(翻訳技術から生まれた仕組み)

生成AIの核心にあるのは「トランスフォーマー(変換器)」と呼ばれる技術です。

この技術は元々、言語を翻訳するために開発されました。

従来の翻訳は、簡単に言えば、英語の単語を日本語の単語に直接置き換えて、整える方法でした。

しかし、この方法では不自然な訳文になりがちです。

トランスフォーマーは異なるアプローチを取ります。

まず入力された文章を「意味表現」というデータに変換します。

これは言語の壁を超えた、意味そのものを表すデータです。

そこから目的の言語に変換するため、より自然な翻訳が可能になりました。

この仕組みを応用すると、意味表現から様々な形式の出力を生成できます。

膨大なテキストデータで学習することで、「この意味表現の後には何が来るか」を予測できるようになったからです。

翻訳の仕組み:

- 英語の文 → 意味表現 → 日本語の文

要約・補完の仕組み:

- 長い文章 → 意味表現 → 短い文章(要約)

- 不完全な文 → 意味表現 → 完全な文(補完)

テキストはもちろん、画像や動画まで。入力も同様に多様な形式に対応できます。これが生成AIの基本原理です。

2. ChatGPTのアプリ

生成AIは、私たちのスマートフォンの中で動いているわけではありません。

実体は大規模なコンピューターシステムで、インターネットを通じて世界中からのリクエストに応答しています。

スマホのアプリは、そのシステムにアクセスするための窓口に過ぎません。

2.1. 検索エンジンの代わりとして

具体例を挙げましょう。

インターネット検索では、広告が画面の大半を占め、目的の情報にたどり着くまで時間がかかることがあります。

このような調べもので生成AIを使うと、整理された形で情報を得られます。

2.2. 創造的な使い方の例—AIに質問させる

使いながら学ぶ。

これも一つの付き合い方です。

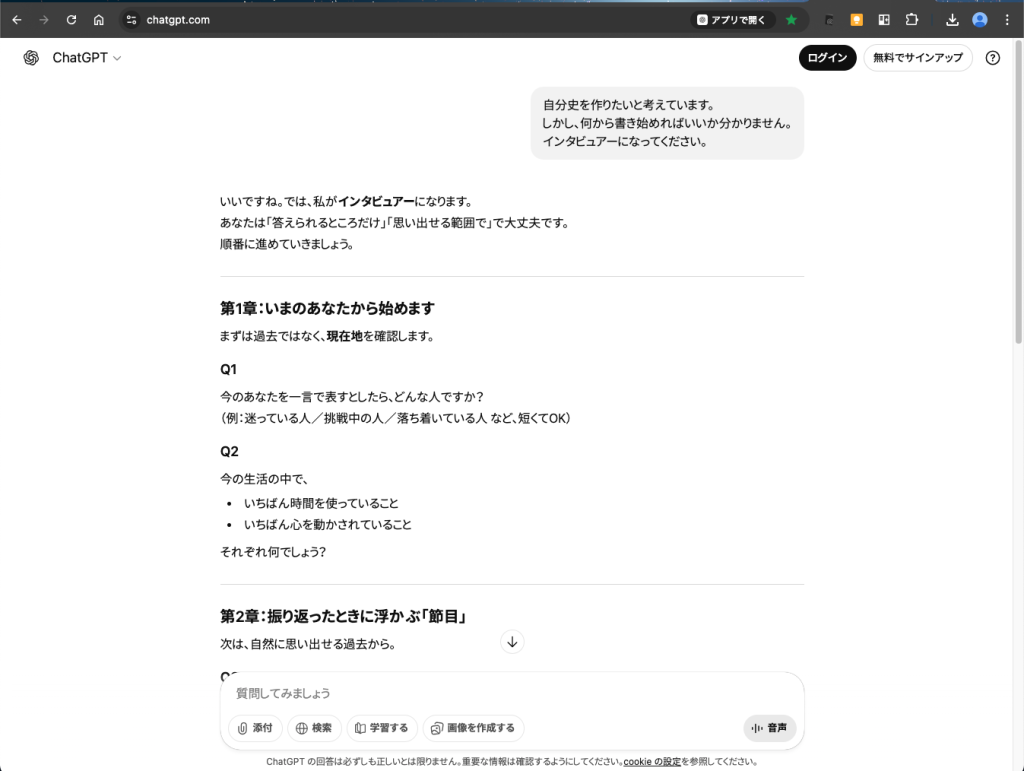

たとえば、「AIに自分へ質問をさせる」という使い方があります。

自分史を作りたいとします。

しかし、何から書き始めればいいか分からない。

そんなとき、AIにインタビュアーの役割を担わせるのです。

自分史を作りたいと考えています。

しかし、何から書き始めればいいか分かりません。

インタビュアーになってください。

AIは順序立てて質問してくれます。

それに答えていくと、情報が自然に蓄積されていきます。

最後にAIに整理を依頼すれば、自分史の土台ができあがります。

このプロセスを通じて、AIの特性や限界についても体感的に理解できます。

3. 二通りの使い方—代替か、拡張か

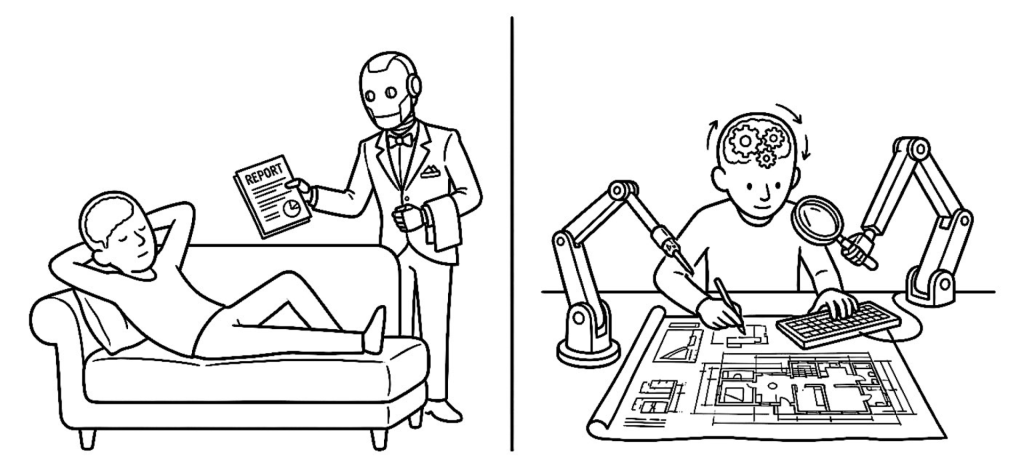

生成AIの使い方は、大きく二つに分けられます。

- 一つ目は「代替・自動化」としての使い方。

AIの回答をそのまま信じ、自分で考えることをやめてしまう使い方です。 - 二つ目は「補助・拡張」としての使い方。

自分の調査や思考を助ける道具として使う方法です。

3.1. AIが抱える三つの弱点

ただし、ここで重要なのは「鵜呑みにしない」こと。

生成AIには明確な弱点があります。

使う際に意識すべき三つのポイントです。

- 情報の正確性は保証されない

- 個人情報は入力してはいけない

- 公開責任は利用者にある

AIは、過去の学習データにある言葉を元に回答を作ります。

このときに、「正しい答え」ではなく「人間が自然で有用だと感じる答え」を優先します。

なぜなら、AIは膨大な人間の文章を学習しており、「こう答えれば人は満足する」というパターンを覚えているからです。

例えば、古い情報と新しい情報が混ざっていたり、別の対象についての情報が紛れ込んでいたりすることがあります。

特に健康や安全に関わる情報については、慎重な確認が必要です。

ぜひ、将棋や園芸など、自分の趣味の分野について、AIに質問してみてください。

素人にはもっともらしく聞こえるが実は間違っている、という回答を生成することが簡単に確認できると思います。

AIの回答を他の信頼できる情報源と照らし合わせたり、複数の視点から確認したりする。

AIの回答は出発点であり、そこから自分で調べ、考えを深めていくのです。

次に、AIに相談をしたとき、その後ろには人間が隠れていることを忘れてはいけません。

AIを提供する企業は「入力された個人情報を外部に漏らさない」と主張しています。

しかし、内部での利用や、予期せぬ形での情報の表出といったリスクは残ります。

安全策としては、個人情報や機密情報は、最初から入力しないこと。これに尽きます。

AIが生成した文章やイラスト・画像を公開するときには、その責任を負うのは公開した人です。

AIではありません。

AIが、著作権や肖像権のリスクを適切に回避してくれるわけではないのです。

公開した文章やイラスト・画像が、社会でどのように受け取られるのか、慎重に考える必要があります。

4. 新たなリスク—フェイク情報の拡散

生成AIの登場により、インターネット上の情報の信頼性に新しい課題が加わりました。

フェイク画像や動画の作成が、技術的な知識がなくても可能になったのです。

特に災害時や危機的状況では、誤情報が急速に拡散するリスクがあります。

情報を受け取る側も、これまで以上に批判的な目を持つ必要があります。

4.1. 批判的に使う姿勢が鍵

生成AIは便利なツールです。

しかし、万能ではありません。

自分で考えることをやめず、AIの回答を批判的に評価する。

個人情報は入力しない。

公開する際は責任を自覚する。

こうした基本を押さえることで、生成AIは強力な味方になります。

技術に使われるのではなく、技術を使う。そのバランスを意識することが、これからの時代には求められています。