「生成AI」は、まるで「複雑な判断ができる知識を備えたロボット」のようにイメージされることが多いです。

しかし、その実態は「電気的に動く脳神経」のようなものです。

これは、「ニューラル・ネットワーク」という仕組みで、入力はたくさんのノードに「オン」「オフ」の形で伝播して、最終的な出力を決めます。

学習初期の出力はまったくの「でたらめ」です。

しかし、「よくない出力」につながる内部の神経回路を細くしていけば、少しずつですが「よい出力」が出やすくなるはずです。

私たちが目にする回答は、このような調整を経たあとの言語モデルが応答として返すものです。

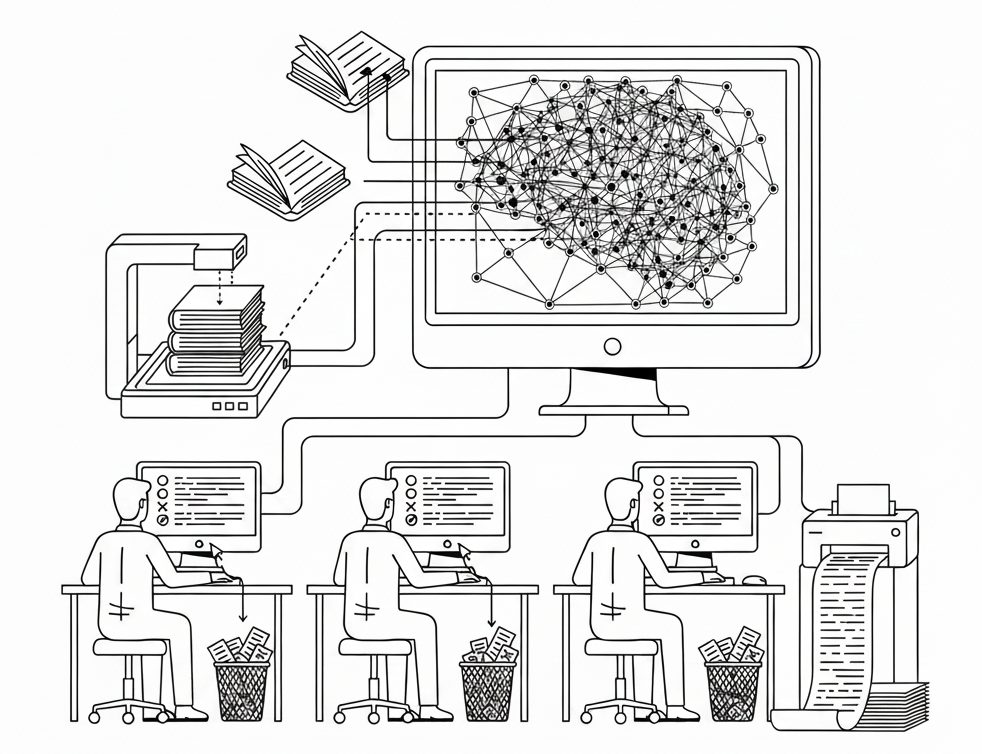

「AIを学習させる」というと、人間が「先生」としてものごとの因果関係を教えているとイメージしますが、実際には求められる出力のパターンを「出やすく」調整しているのです。

1. 手書き数字認識の「学習」

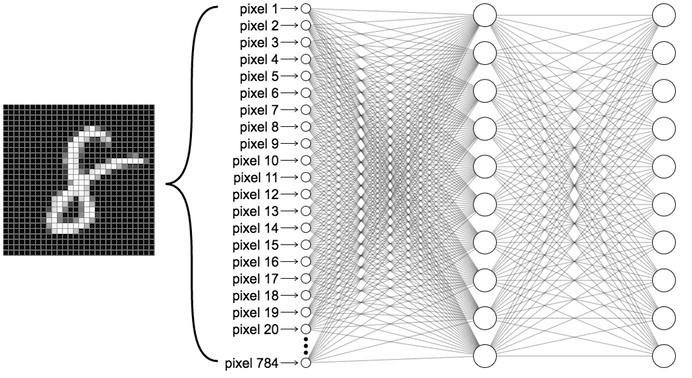

たとえば、もっとシンプルなニューラルネットワークに、手書き数字認識(MNIST)があります。

これは、生成ではなく画像認識ですが、画像と答えとなる数字を与えて、ニューラルネットワークの「配線(重み付き)」を調整していくと、段々と精度が上がっていくことが観察できます。

この調整のことを「学習」と言っています。

ここで面白いのは、まったく数字ではなく画像を与えても、何か反応として数値を回答する、ということです。

また、「0」と「6」など人間でも判断が分かれるものもあります。

そもそも、このような自由な入力では、答えが一つに定まるとは限りません。

2. 生成AIは「でたらめ」からスタートしている

ニューラルネットワークが面白いのは、必ずしも学習したもの以外にも回答を出力できることです。

これは、もともとでたらめの出力を調整していったものなので、ある意味当たり前です。

なんでも、とりあえず回答を出力できます。

ただ、その回答が正しいか、有用かは二の次です。

あくまでは、それを決めるのは利用者側だからです。

ここでわかるのは、生成AIの回答は、「正しい」ものではない、ということです。

十分に正しそうで、十分に有用そうになるように調整されたのものを使っています。

しかし、「正しい答え」が存在しないものまで回答します。

まだ、正しい答えがわかっていないものにも回答します。

高度に複雑になったニューラルネットワークで、どんな作用が起こっているかは理解できず、結果だけを見て判断しているのです。

こういう道具であることを理解して使う必要があります。