- SKILL.mdはファイル形式ごとに用意されたベストプラクティス集で、Claudeは回答生成前に毎回これを読み込みます。

- 合計3.9MBに達するスキルファイルをコンテキストに積み込むことで、出力品質を安定させています。

- Claudeが会話をまたいで記憶を保持しない設計のため、すべての指示を毎回読み直す必要があります。

- スキルファイルはMarkdownで書かれているため、コードを変えずにドキュメントを編集するだけでClaudeの挙動を変えられます。

1. SKILL.mdを読み込む処理

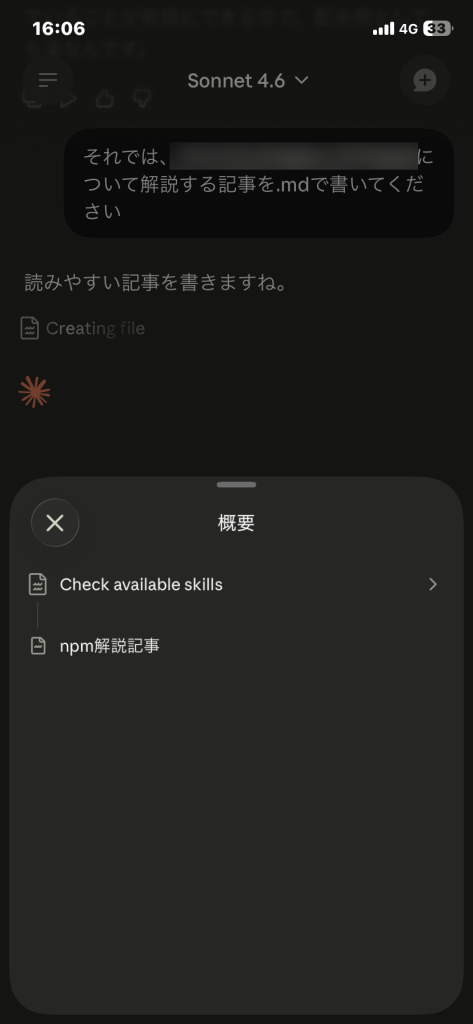

Claude Sonnet 4.6 に Markdown 記事を書くよう頼んだら、回答を生成する前に /mnt/skills/public 以下にある複数の SKILL.md ファイルを読み込む動作が走りました。

docx・pdf・pptx・xlsx・frontend-design など、ファイル形式ごとに用意されたベストプラクティス集で、合計サイズは 3.9MB に達します1。

Claude は「試行錯誤で蓄積されたノウハウ」をプロンプトとして毎回受け取る設計になっています2。

たとえば、Word 文書を作るときは docx/SKILL.md(20KB)、PDF なら pdf/SKILL.md と REFERENCE.md と FORMS.md を合わせて読む、という具合です。

スキルファイルの内容をコンテキストウィンドウに積み込むことで、出力品質を安定させています3。

冒頭の画像で Check available skills というステップが映っているのがこの読み込み処理で、「Creating file」の直前に実行されていることがわかります。.

md 記事の生成という比較的シンプルな依頼でも、関係しうるスキルを確認してから書き始めます。

2. スキルのトークン消費と柔軟性

ただし、この仕組みは、賢さとトークン消費の交換です。

たとえば pptx/SKILL.md は 9KB、さらに pptxgenjs.md が 13KB あり、スライド生成ひとつで 20KB 超のドキュメントが文脈に入ります4。

ユーザーには見えませんが、確実にトークンを消費しています。

Claude の機能が増えるほど、スキルファイルも増えます。

便利になるほどバックグラウンドのトークン消費も増えていく構造は、現在の LLM アーキテクチャの宿命に近いものがあります。

Claude がすべての指示を毎回読み直す必要があるのは、会話をまたいで記憶を保持しない設計だからです。

裏を返せば、スキルファイルの中身を改善するだけで挙動を変えられます。

ソフトウェアのコードを書き換えなくても、Markdown ドキュメントを編集すれば Claude の出力が変わる。

この柔軟性が、トークンコストを払ってでも採用されている理由でしょう5。

- 3.9MB のテキストは、1トークンあたり約0.75英単語換算でおよそ130万トークン相当になります。ただし実際にコンテキストに読み込まれるのは必要なスキルファイルのみで、すべてが一度に展開されるわけではありません。

- LLM は本質的にステートレスな設計です。各リクエストは独立して処理され、過去の会話はモデル自身には残りません。セッション内で文脈が維持されているように見えるのは、アプリ側がすべての会話履歴を毎回プロンプトに含めて送信しているためです。 – Stateful vs Stateless LLMs: What’s the Difference and Why It Matters

- コンテキストウィンドウとは、モデルが一度に参照できるテキストの上限量のことです。claude.ai の有料プランでは 200,000 トークン(約50万語相当)が標準で、Enterprise プランでは 500,000 トークンまで拡張されます。 – How large is the context window on paid Claude plans?

- 200,000 トークンのコンテキストウィンドウに対し、20KB のテキストはおよそ 5,000〜7,000 トークン相当です。スキルファイルだけで枠の 3〜4% を占める計算になります。また、200,000 トークンを超えるリクエストは API 料金が 2 倍になります。 – Context windows – Claude API Docs

- コンテキストに詰め込む情報が多いほど精度が上がるとは限りません。スタンフォード大学らの研究「Lost in the Middle」(TACL 2024)によると、関連情報がコンテキストの中央付近に位置すると、先頭・末尾に比べてモデルの精度が 30% 以上低下する場合があります。スキルファイルをすべて読み込むより、必要なものだけを先頭近くに配置する設計が現実的です。 – Lost in the Middle: How Language Models Use Long Contexts