SNSでは、Google NotebookLMや、いわゆる「第二の脳」をうたう生成AI系ツールについて、かなり期待値の高い言葉を見かけます。

「資料を全部入れれば、全部理解して要約してくれる」「考える必要がなくなる」といった表現です。

便利なツールですが、過度の期待も禁物。

生成AIの基本的な仕組み、とくにコンテキストウィンドウとRAGを理解すると、その真価がわかります。

1. コンテキストウィンドウという見えない制約

生成AI(LLM:大規模言語モデル)を使う上で、まず避けて通れないのが、コンテキストウィンドウ(context window)です。

これは「生成AIが一度に参照できる情報量の上限」のことです。

文章はトークンという単位に分割され、その合計数に上限があります。

最近のモデルでは最大百万トークン以上を扱えるものもあります。

ただ、それでも無限ではありません1。

しかも、たくさん入ればよいというものでもありません。

チャットが長くなればなるほど、どの情報が重要かを見極めるのは難しくなるからです(生成AIはチャットが長くなるほど、休息に回答が不鮮明になっていきます)。

これが、「全部入れれば全部分かる」という表現は、やや誇張していると感じる理由です。

1.1. NotebookLMが使っているRAGという仕組み

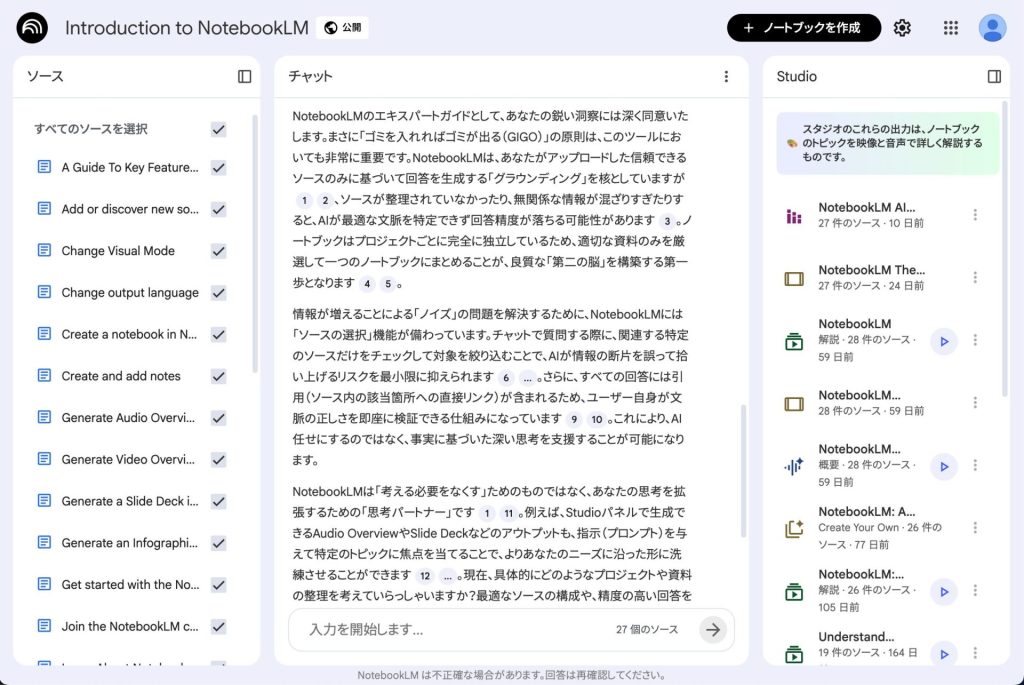

では、NotebookLMはどのように大量の資料を扱っているのでしょうか。

そこで使われているのがRAG(Retrieval‑Augmented Generation)です2。

RAGは、日本語にすると「検索拡張生成」くらいの意味です。

すべての資料を毎回丸ごと読むのではなく、質問に応じて関連しそうな部分だけを検索で取り出し、それを材料に文章を生成します。

これはとても合理的な設計です。

人間でも、何百ページもある資料を毎回全部読むのではなく、必要な箇所を探します。

それと似ています。

2. ほんとにデータを増やせば賢くなる?

ただし、ここに一つ前提があります。

RAGは「すべての本質を理解して選ぶ」仕組みではないこと。

「質問」があって初めて情報を検索し、選んだものだけで回答します。

そして、検索で選ばれなかった資料は、その回答では使われません。

膨大なデータを関連付けて回答しているわけではないのです。

資料が増えれば、検索対象も増えます。

その結果、少しズレた文脈の断片が拾われたり、本当に重要な部分が出てこなかったりします3。

ちょうど話があちこちに飛んだら、どんな回答をすればよいか逆にわからなくなるのと一緒です。

つまり、データが増えるほど万能になるわけではない、ということです。

むしろ、与えたデータが整っていないと回答精度が落ちることもあります。

人間だって、インターネット上にはたくさんの情報があり、必要に応じて取得できますが、だからといって「すべてを理解した」とは言えませんよね。

これは失敗というより、仕組み上自然な挙動だと捉えています。

「gabbage in, gabbage out(ゴミを入れればゴミが出る)」という言葉がありますが、

LLMの場合は「整理されていない大量の情報を入れると、整理されていない答えが返りやすくなる」と言い換えられる気がします。

3. でも、限界を知っている方が使い道は広がる

NotebookLMなどのAIサービスに限界があるといっても、それが「役に立たない」わけではありません。

むしろ逆です。

「RAG」というシステムが、一般ユーザーでも活用できるようになったことは画期的なことです。

しかし、その使い方には「コツ」があります。

- どの資料を入れるかを選ぶ

- 前提や観点を自分の言葉で与える

- 出力をそのまま信じず、確認する

こうした作業を前提にすると、NotebookLMはかなり強力な道具になります4。

RAGは、「何でもまとめてくれる魔法の箱」ではありませんが、

「考えるための下書きを高速に作る道具」としては、十分に価値があります。

こうした前提を理解していくこと自体が、「AIリテラシー」の一部なのではないか、と考えています。

- NotebookLM の最新アップデートでは、Gemini 系モデルを活用してコンテキストウィンドウを大幅に拡張し、最大百万トークン前後まで扱えるようになっています。これにより、より大きなドキュメントや長い会話履歴を一度に参照しやすくなっています。 – NotebookLM gets 8x larger context window and smarter responses(TechRadar)

- RAG(Retrieval-Augmented Generation)は、LLM が外部のデータを検索し、関連情報を取り出した後、それを元にテキスト生成部分(Generator)が回答を組み立てる二段階の仕組みで動作します。 – NotebookLMとRAGの違い(Book.st-hakky.com)

- RAG システムでは、検索対象が大きくなるほど関連性の低いチャンクが返される可能性が増え、誤った情報を含んだ出力を生成するリスクも高まります。これはベクトル検索や再ランクアルゴリズムが「関連度」を元に情報を選ぶためです。 – NotebookLM uses retrieval augmented generation(Wonder Tools)

- NotebookLM は、アップロードされたドキュメントの整理・要約・質問応答を効率化する AI ツールであり、特定の資料に基づいたクエリに高い精度で答える能力があります。ただし一般的に RAG ベースの生成は出典との整合性や関連度評価に課題が残ることがあります。 – NotebookLMとは?AIを搭載した次世代ノートアプリ(Yoshidumi)