- ChatGPTの回答品質は、モデルの選択や思考時間の設定、渡す前提情報によって大きく変わる。

- 複雑な質問には、速度より推論に特化したモデルを最初から選んだほうが結果が安定しやすい。

- 最新情報が必要なときはウェブ検索やDeep researchを使うよう指示することで、出力の質が変わる。

1. 回答品質は一律ではない

ChatGPTの回答精度に不満を持つ人は少なくありません。

ただ、ChatGPTには、いろんな機能があるので、自分へのChatGPTの回答だけで「賢いか、賢くないか」は判断できません。

同じChatGPTでも、どのモデルを選ぶか、どれくらい考えさせるか、どんな前提を渡すかで、返ってくる内容はかなり変わるからです。

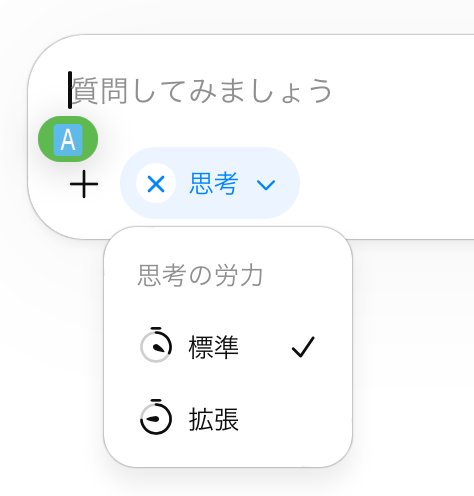

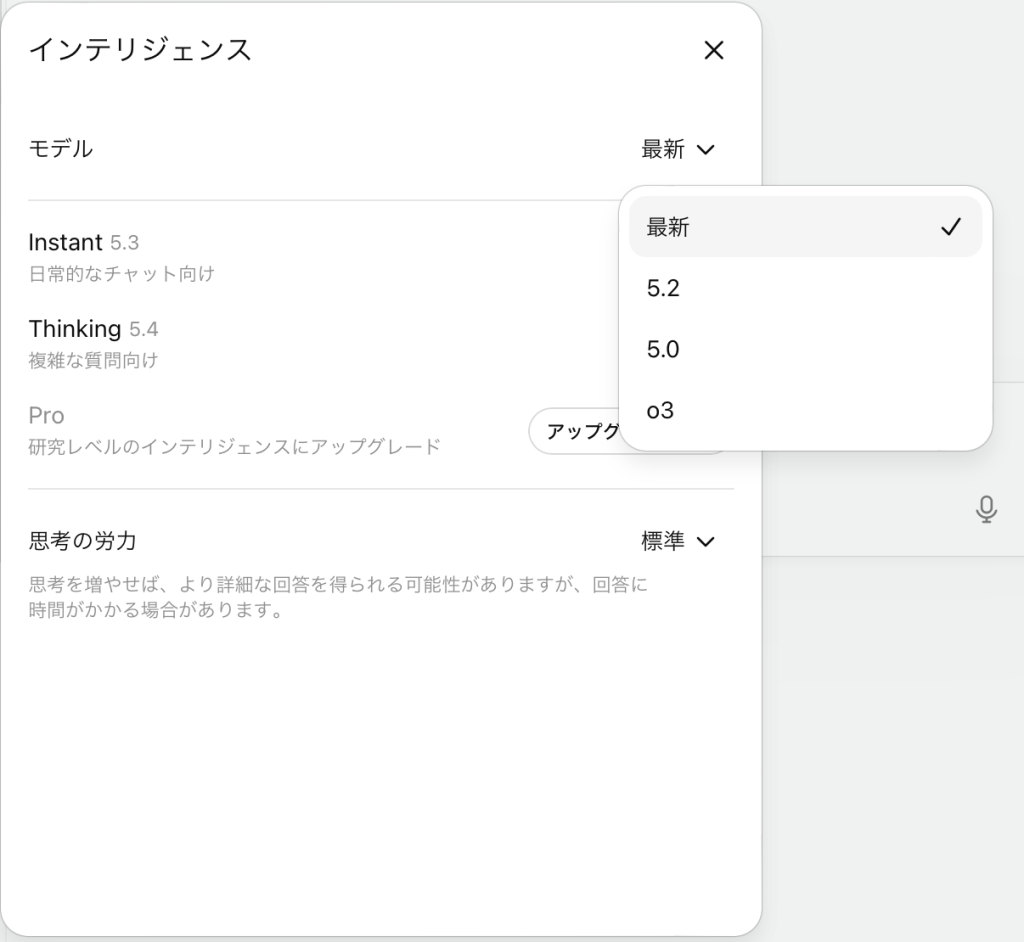

2. 思考時間を選ぶ

回答精度は、性能だけで決まるわけではありません。

必要なら、思考量を増やします。

Instant と Thinking のように、用途の違いで分かれています。

日常の短いやり取りでは、待たずに返ってくることに価値がありますが、複雑な質問や整理の難しい依頼では、速度より考える時間のほうが結果を左右します。

速さと緻密さはしばしば両立しません。

速さ、トークン消費、推論時間との兼ね合いがあるので、常に最も重い処理が自動で選ばれるとは限りません。

通常は、自動調整によって、質問の内容によって切り替わっていますが、複雑な問いなら、最初からそれに向いたモデルを使ったほうが結果は安定しやすいです。

自動調整に任せるだけでなく、必要に応じてユーザー側がモデルを選ぶ必要があります。

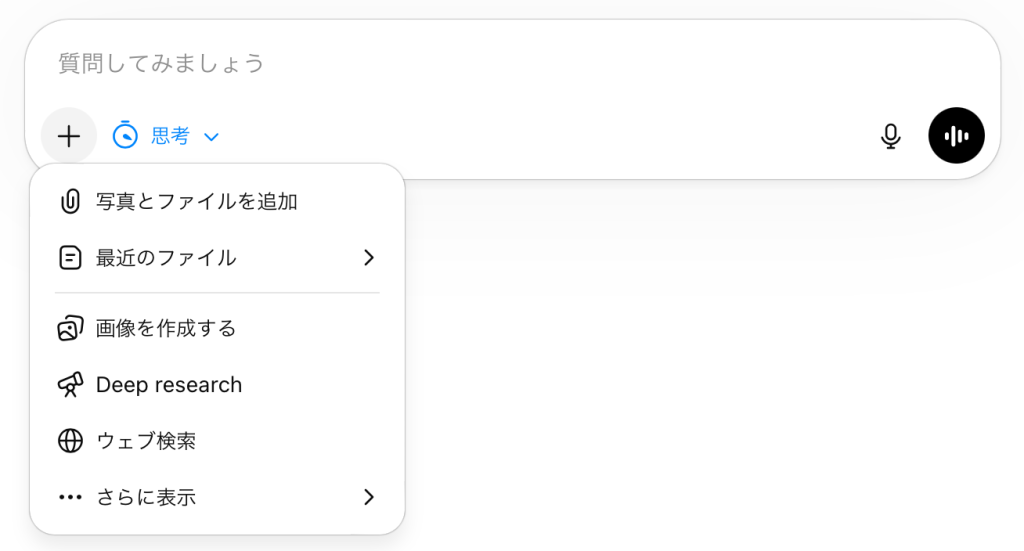

3. ウェブ検索を使わせる

出力の質を左右する要素として重要なのは、入力情報の質です。

最新情報が必要ならウェブ検索ツールを使うように指示することを忘れてはいけません。

さらに、用途別の入口が用意されていることも見逃せません。

Deep research のような機能があり、調査対象の数量についても変更できます。

通常の会話モードだけで済ませれば、期待した精度にならないのは不思議ではありません。

4. 文脈を指定する

もうひとつは、前提条件を明示することです。

プロンプトは AI への指示文のこと。

何について答えるのか、どの立場で書くのか、何を避けるのか、どこまで詳しくするのか。

この情報がないままだと、もっともらしい一般論が返りやすくなります。

問いが曖昧なままだと、どれだけ高性能なモデルでも曖昧な答えになりやすいです。

使いこなせば万能になるわけではありませんが、使い方で改善できる余地があるという意味です。

ただ、何も調整せずに試した結果だけで精度を断定するのも早すぎます。

限界があることと、評価の仕方が粗いことは別の話です。